- 1. Kluczowe algorytmy i mechanizmy uczestniczące w Core Update 🧠⚙️

- 2. Co mówią eksperci ze świata SEO o tym update 🧩

- 3. Moja analiza Core Update 🧠⚡

- 4. Przegląd zwycięzców i przegranych ⚔️

- 5. Czy przewidywania ekspertów się sprawdziły? 🤔

- 6. Jak tworzyć treści, by podczas Core Update zyskiwały? ✍️🧠

- 7. Co zrobić po Core Update? Rekomendacje praktyczne? 🛠️

- Kiedy zobaczysz efekty zmian na stronie? ⏳

- Podsumowanie 🧠⚡

- Słownik pojęć użytych w artykule

- FAQ – najczęstsze pytania po Core Update grudzień 2025

Google ogłosiło December 2025 Broad Core Update 11 grudnia 2025 roku. Oficjalnie – kolejna „rutynowa” aktualizacja rdzenia algorytmu.

Nieoficjalnie? Świat SEO od pierwszych godzin zaczął mówić o nadchodzącym trzęsieniu ziemi. I nie bez powodu. Już sam timing – końcówka roku, okres świąteczny, mniejsza aktywność zespołów – wzbudzał niepokój. A gdy w SERP-ach pojawiły się pierwsze, bardzo gwałtowne ruchy, stało się jasne, że to nie będzie zwykły core update „do przeczekania”.

Celem aktualizacji – przynajmniej według komunikatów Google – było lepsze promowanie treści relewantnych, satysfakcjonujących użytkownika i realnie pomocnych, niezależnie od typu strony. Brzmi znajomo. Problem w tym, że grudniowy core update wyglądał inaczej niż poprzednie. Zmienność była skrajna, nielogiczna, momentami wręcz „nienaturalna”. Jedne sektory dostawały obuchem w głowę, inne rosły mimo oczywistych problemów jakościowych. Wiele stron znikało z topów dosłownie z dnia na dzień, by po chwili częściowo wracać.

Dlaczego więc aż takie emocje? Jednym z głównych powodów było przekonanie – coraz mocniej poparte obserwacjami – że Google w coraz większym stopniu wykorzystuje systemy oparte o AI do analizy jakości stron, treści i zachowań użytkowników. Nie mówimy już tylko o klasycznych sygnałach on-page czy linkach, ale o próbie całościowego „zrozumienia” strony: jak się z niej korzysta, czy daje realną wartość, czy użytkownik jest zadowolony, a nawet czy treść wygląda na stworzoną z myślą o człowieku, a nie o algorytmie. To właśnie ta kombinacja – AI, UX, E-E-A-T i zachowań użytkowników – sprawiła, że grudniowy core update był zapowiadany jako jeden z najbardziej przełomowych od lat. Tym samy pozycjonowanie stron internetowych, staje się co raz bardziej złożone.

1. Kluczowe algorytmy i mechanizmy uczestniczące w Core Update 🧠⚙️

W grudniowym Core Update nie mieliśmy do czynienia z jednym algorytmem, który „zrobił robotę”. To był zestaw współpracujących ze sobą mechanizmów, których łączny efekt dał obserwowane turbulencje w wynikach wyszukiwania.

Najważniejsze z nich:

-

Navboost – bardzo duży wpływ

Mechanizm silnie powiązany z zachowaniem użytkownika na stronie. Obejmuje m.in.:

kliknięcia, satysfakcję użytkownika, UX jako całość, reklamy, affiliate links, popupy, prędkość ładowania.

Glenn Gabe nazywa Navboost jednym z kluczowych czynników tego Core Update. W praktyce oznacza to, że nawet dobra treść może przegrywać, jeśli użytkownik ma problem z jej realnym konsumowaniem. -

E-E-A-T (szczególnie Experience i Expertise) – znacząco zwiększona waga

E-E-A-T przestało być ograniczone wyłącznie do klasycznego YMYL.

Experience i Expertise są teraz szeroko stosowane również w:

recenzjach, poradnikach, contentcie komercyjnym, buying guides.

Sam „research” przestaje wystarczać — liczy się realne doświadczenie autora. -

Quality signals / content quality evaluation

Fundamentalna recalibracja sposobu oceniania treści pod kątem:

autentyczności, realnej wartości dla użytkownika oraz braku manipulacji pod SEO lub AI.

Google znacznie lepiej odróżnia treści pisane „żeby pomóc” od treści pisanych „żeby rankować”. -

AI content detection / human expertise signals

Wyraźnie lepsza identyfikacja treści masowo generowanej przez AI bez ludzkiego nadzoru.

To nie jest ban na AI.

To kara za brak jakości, ekspertyzy i odpowiedzialności autora.

AI jako narzędzie — OK. AI jako taśma produkcyjna — bardzo ryzykowne. -

Core Web Vitals – podniesione progi / większa waga

Techniczny UX zyskał na znaczeniu.

Strony wolne, przeładowane reklamami i skryptami, z problemami INP czy LCP, przegrywały nawet przy solidnym contencie. -

Freshness signals

Bardziej wyrafinowane rozróżnianie prawdziwych aktualizacji treści od manipulacji typu:

zmiana daty, kosmetyczna edycja, sztuczne „odświeżanie”.

Aktualizacja musi realnie wnosić nową wartość. -

SpamBrain / systemy antyspamowe

Pośrednio wzmocnione.

Spam i thin content chwilowo zyskały, co było mylące, ale wszystko wskazuje na to, że to tylko etap przejściowy.

Spodziewane są kolejne akcje antyspamowe (follow-up). -

User satisfaction / behavioral signals

Ogólnie silniejszy fokus na holistyczne doświadczenie użytkownika i genuine value — nie tylko sam content, ale całe otoczenie strony, sposób konsumpcji treści i reakcje realnych użytkowników.

Szerzej o tym pisałem w artykule: Jesteście gotowi na Google Core Update w grudniu 2025?

2. Co mówią eksperci ze świata SEO o tym update 🧩

Grudniowy Core Update był na tyle nietypowy, że bardzo szybko stał się głównym tematem analiz wśród topowych ekspertów SEO na świecie. Poniżej zebrałem najważniejsze wnioski od osób, które od lat śledzą algorytmy Google, mają dostęp do dużych zbiorów danych i regularnie komentują realne zmiany w SERP-ach. Te obserwacje dobrze spinają się z tym, co sam widziałem na projektach w trakcie i po aktualizacji.

2.1 Wnioski od Glenn Gabe:

-

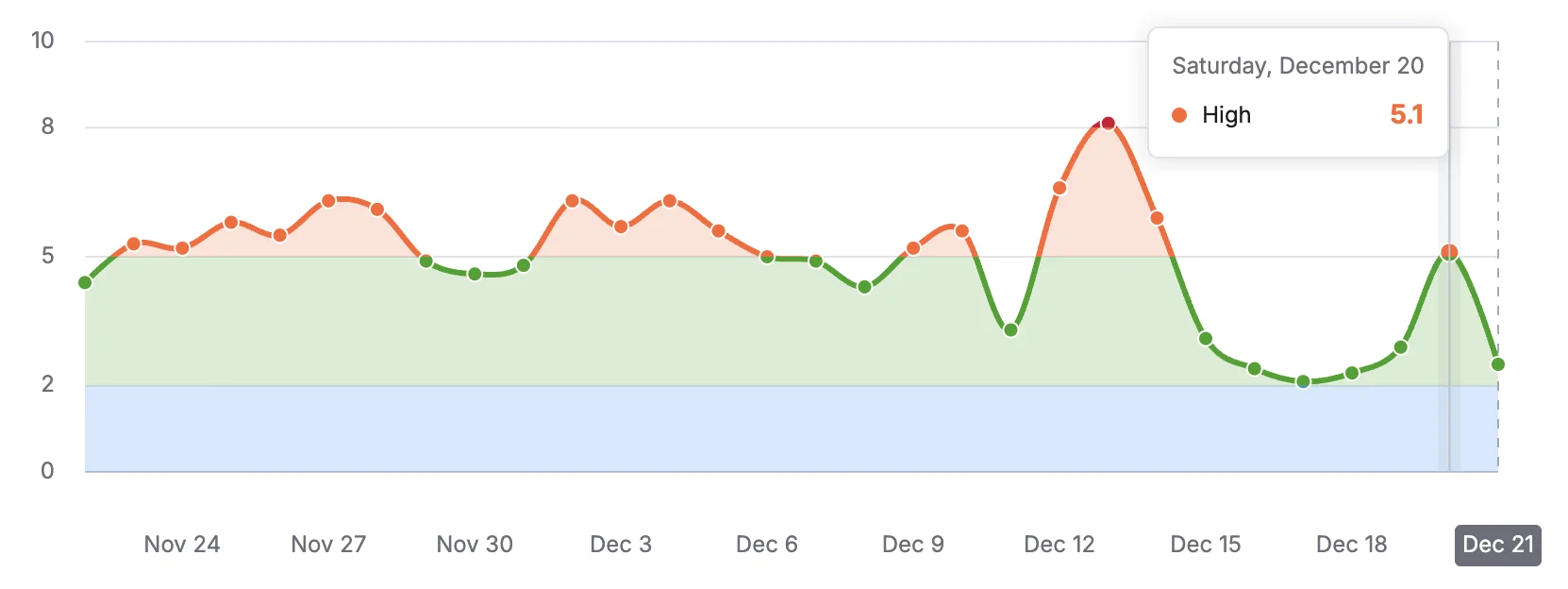

Update trwał 18 dni (11–29 grudnia 2025), największy tremor 20 grudnia.

-

Najmocniej uderzył w YMYL (finanse + zdrowie/medycyna) – masowe spadki nawet u autorytetów.

-

Navboost (całościowy UX + reklama + affiliate + popupy) miał ogromny wpływ na rankingi.

-

Fora (zwłaszcza zdrowotne) mocno spadły (m.in. przez zmianę SERP features).

-

Duże spadki u wydawców newsowych i w Google Discover.

-

Spam i thin content chwilowo zyskały → spodziewana akcja antyspamowa wkrótce.

-

Wirecutter znowu mocno spadł mimo jakości → pokazuje, że sama treść to za mało.

-

Odzyskiwanie po spam updates możliwe – ale trwa miesiące realnych poprawek.

-

Reddit z AI-tłumaczeniami treści mocno urósł (np. Europa).

-

Czysta treść AI bez ludzkiej edycji → bardzo ryzykowne (spadki + manual actions).

-

Klucz do przetrwania: jakość + UX + eliminacja thin content + ludzki nadzór nad AI.

-

Następna duża aktualizacja prawdopodobnie wiosna 2026 (marzec?).

2.2 Wnioski od Lily Ray

Update spowodował dużą zmienność, szczyt 13 i 20 grudnia; analiza na podstawie SISTRIX Visibility Index (803 domeny) + Similarweb.

-

Najmocniej zyskały eCommerce i retail (zwłaszcza apparel, general merchandise, transactional content) – średnio +14% w kategorii; dominują marki jak Aritzia +56%, JC Penney +52%, Nordstrom Rack +35%, Zara +34%, Kohls +30%.

-

Finanse szeroko w górę (+15% średnio): Cigna +107%, Robinhood +55%, Bankrate +10%, Fidelity +9%.

-

Travel/Hotele/OTAs zyskały (IHG +32%, Hilton +14%, Hotels.com +8%, VRBO +20%), ale niektóre łańcuchy spadły (Marriott -12%).

-

Zweryfikowane recenzje i rankingi mocno w górę: Trustpilot +49%, Niche.com +13%, Healthgrades +31%, Capterra +61%.

-

Słowniki/reference: mieszane, Thesaurus.com +33% mocno w górę, Merriam-Webster -11% w dół.

-

Duże spadki UGC/social/Q&A: Wikipedia -5% (największa strata absolutna -435 pkt), Reddit -3%, Quora -25%, Facebook/Instagram/YouTube/X/TikTok/Pinterest spadki 2–23%; fora jak Stack Overflow -16%.

-

News publishers mocno w dół: NYT -21%, Newsweek -59%, BBC -18%, CNN -12%, Reuters -34%.

-

Health/YMYL prawie uniwersalne spadki: Healthline -27%, WebMD -19%, Mayo Clinic -7%, Cleveland Clinic -8%, MedicalNewsToday -42%.

-

Recenzje/aggregatory UGC spadły: TripAdvisor -8%, Yelp -2%, Edmunds -18%.

-

Wzrosty w eCommerce i finansach sugerują faworyzowanie komercyjnego, transactional content od uznanych marek.

-

Spadki UGC/social/forów wskazują na dalsze osłabianie niekontrolowanych treści użytkowników na rzecz zweryfikowanych/eksperckich źródeł.

-

Część spadków (social, niektóre health/news) odbiła po zakończeniu update’u.

2.3 Lista wniosków od Barry Schwartz

-

Update oficjalnie zakończony 29 grudnia 2025 o ~14:05 ET → rollout trwał dokładnie 18 dni i 2 godziny (start 11 grudnia ~12:25 ET).

-

Nazwa: Google December 2025 Broad Core Update (regularna aktualizacja rdzeniowa).

-

Cel: lepsze promowanie relevant, satisfying content ze wszystkich typów stron (nie penalty, tylko nagradzanie dobrych stron).

-

Globalny wpływ: wszystkie regiony, języki, dotyczy też Google Discover, featured snippets i innych funkcji.

-

Nietypowy wzór zmienności: największe skoki 13 grudnia i 20 grudnia (oba soboty), potem bardzo spokojnie → John Mueller zasugerował, że update może być już skończony wcześniej.

-

To trzecia core update w 2025 roku (po marcu i czerwcu) – mimo zapowiedzi częstszych aktualizacji, w tym roku wyszły tylko trzy.

-

Brak oficjalnej listy zwycięzców/przegranych; w chatterze: raporty o spadkach nawet 90% ruchu, niektóre strony zyskały lekko, thin content chwilowo faworyzowany.

-

Wpływ na news publishers zauważalny (w późniejszych video Barry wspomina o „incredibly hard” uderzeniu w niektórych).

-

Rady dla SEO: skup się na poprawie jakości treści zgodnie z Google core update guidance; odzyskiwanie możliwe, ale wymaga realnych zmian.

3. Moja analiza Core Update 🧠⚡

Większość omawianego Core Update cechowała się ciszą w zmiennościach wyników wyszukiwania – skrajną ciszą. I właśnie ta cisza była najbardziej niepokojąca. Być może mamy tu kolejne potwierdzenie teorii zamrożenia wyników wyszukiwania, o której coraz częściej mówi się w branży.

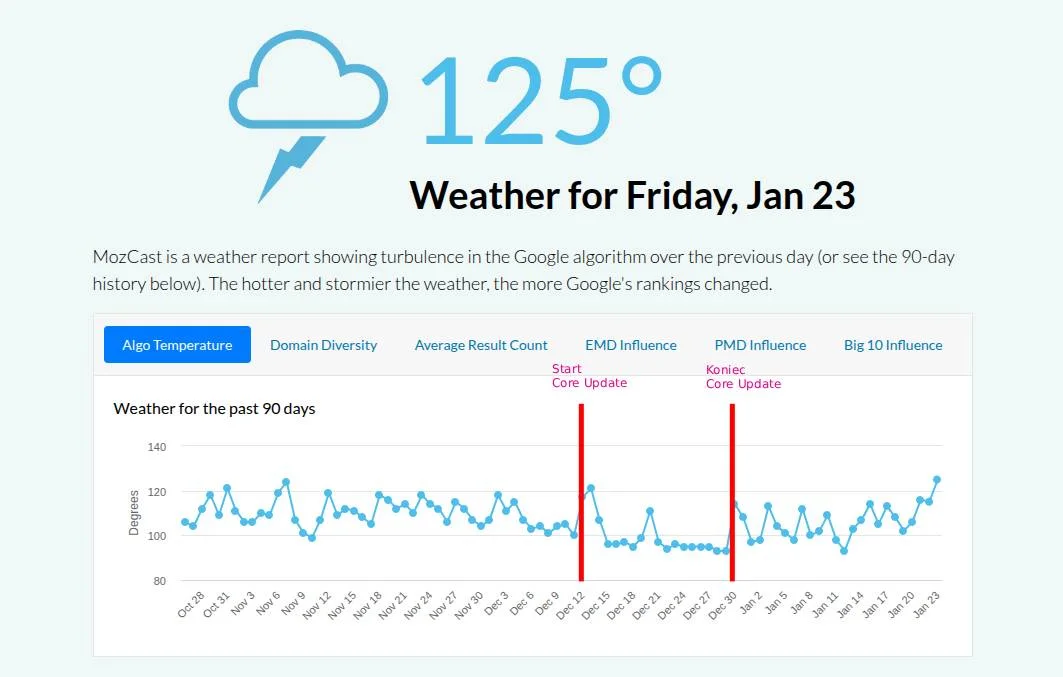

Na potrzeby tej analizy podzieliłem Core Update na trzy wyraźne fazy, które bardzo dobrze tłumaczą to, co działo się w SERP-ach w grudniu i tuż po nim.

I. Odmrożenie wyników ❄️➡️🌊

Po ogłoszeniu Core Update mieliśmy gwałtowne roszady w wynikach wyszukiwania, ale praktycznie tylko na samym początku, szczególnie 13 grudnia. Wyglądało to tak, jakby wyniki wyszukiwania zostały na moment odmrożone i stały się bardziej płynne.

Taka ciekawostka, ale bardzo powtarzalna. Prawie wszystkie strony, z których usuwałem fluff content na poziomie 20%+ w stosunku do całości treści, na początku Core Update spadały. I to zarówno w grudniu 2025, jak i wcześniej w czerwcu 2025 roku. Co istotne — zaraz po ogłoszeniu zakończenia Core Update wracały.

To może wskazywać na bardzo ciekawy mechanizm:

na początku aktualizacji rdzenia wyniki są „odmrażane”, a wyrwa w strukturze treści ciągnie stronę w dół. Niezależnie od tego, jaka to była treść. Nawet słabszy content dawał stronie pewną moc — chociażby przez historię rankingu czy linki zewnętrzne prowadzące do tych URL-i. Gdy go usuwamy, pojawia się luka, która w tej fazie update’u jest natychmiast widoczna.

II. Czas przeliczania 🧮🤖

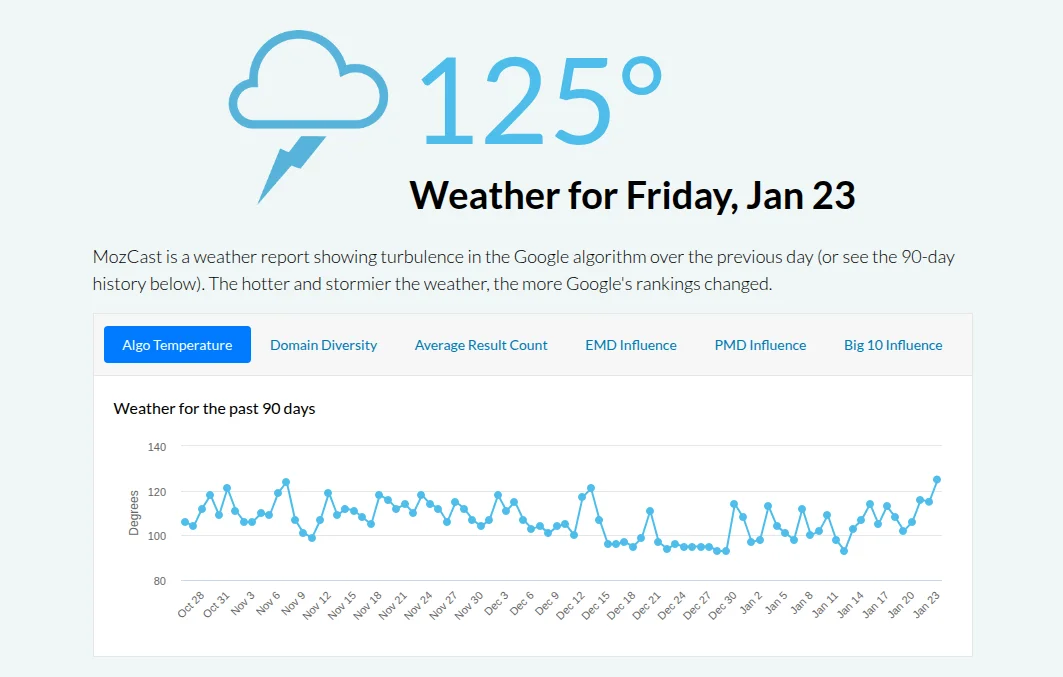

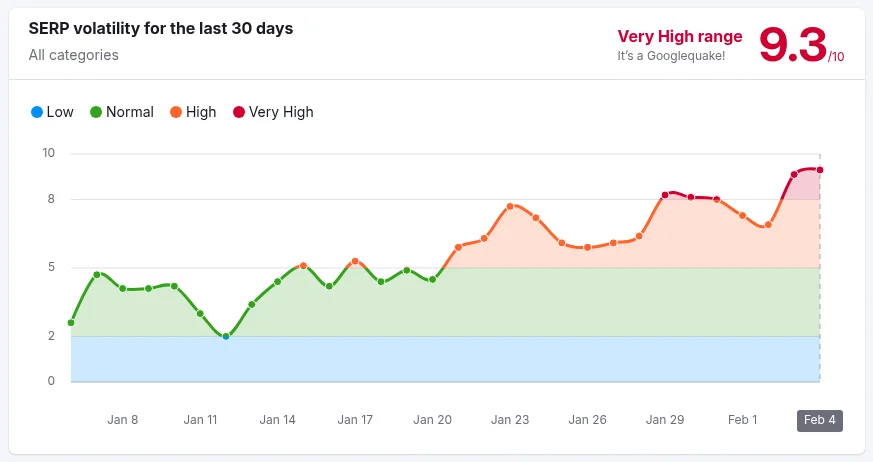

Po początkowym zamieszaniu zmienność wyników bardzo szybko się skończyła. Poza jednym wyraźnym pikiem 20 grudnia mieliśmy względny spokój. Spokój rekordowo głęboki i rekordowo długi.

Wszystkie narzędzia mierzące zmienność SERP-ów pokazywały wartości poniżej wcześniejszych historycznych minimów. Tak nie wygląda klasyczny Core Update.

Widać było wyraźnie, że maszyny zajmują się czymś innym — przeliczaniem. I mamy na to kilka pośrednich dowodów:

-

problemy z działaniem narzędzi opartych o AI i chaty,

-

opóźnienia i dziwne zachowania w indeksacji w GSC,

-

ogromne problemy z działaniem PageSpeed Insights — momentami po prostu nie działało.

Ewidentnie było widać problemy operacyjne po stronie Google. Rekordowo niska zmienność w SERP-ach oznacza jedno: moc obliczeniowa poszła gdzie indziej. W tym czasie zmiany rankingów dotyczyły raczej delikatnych korekt opartych o dane historyczne i większą płynność, a nie realne przetasowania.

III. Wprowadzenie wyników obliczeń 🌋

Oficjalnie koniec Core Update ogłoszono 29 grudnia. I tutaj dochodzimy do bardzo ważnej rzeczy.

Moim zdaniem Google ogłasza koniec rolloutu w momencie, gdy zmiany algorytmiczne są wdrożone. Progress bar dobija do 100%, komunikat idzie w świat, Core Update „zakończony”. Tyle że… dla właścicieli stron to dopiero początek.

Właśnie wtedy wchodzą w życie:

-

nowe kalibracje,

-

nowe oceny jakości,

-

przeliczone SQS (Site Quality Score).

I to one zaczynają wywoływać prawdziwe trzęsienie ziemi.

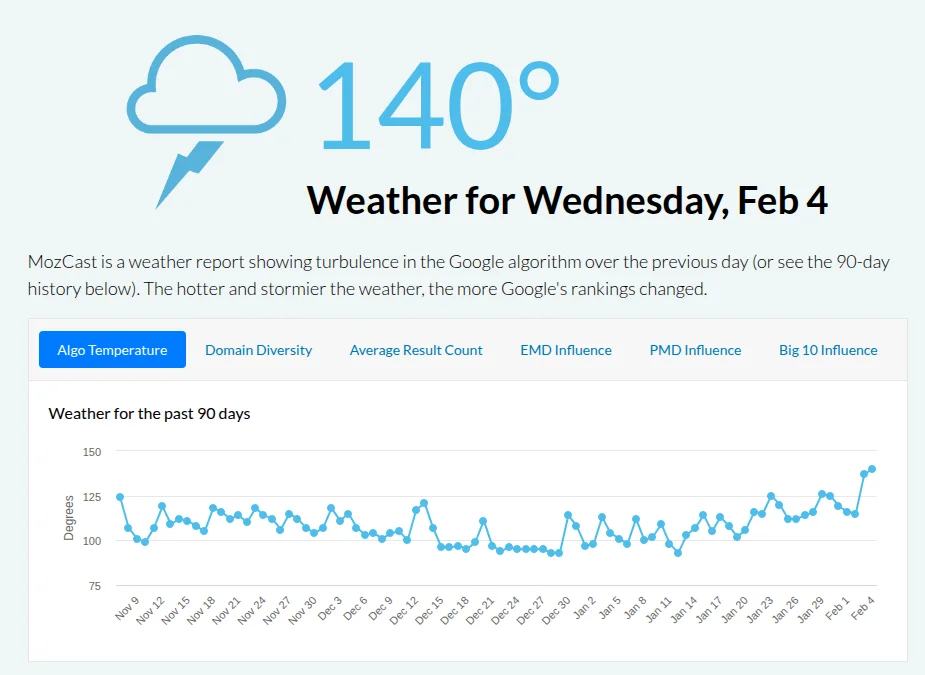

Dokładnie dzień po ogłoszeniu końca Core Update, czyli 30 grudnia, zaczęło się dziać. Na screenach widać, że turbulencje się nasilają. Mają swoje wahania, ale w uśrednieniu rosną. Pisząc ten artykuł, jesteśmy w największej burzy w SERP-ach od wielu lat.

Nie sądziłem, że jeszcze zobaczę Moz Weather pokazujący 140 stopni. Nie mam danych porównawczych z czasów pierwszego Pingwina i Pandy, więc nie będę ryzykował stwierdzenia, że to „rekord rekordów”. Ale jedno wiem na pewno — to nie jest normalna zmienność.

I to właśnie w tej fazie zaczyna się prawdziwy test E-E-A-T, jakości, UX i sensu istnienia strony jako całości.

4. Przegląd zwycięzców i przegranych ⚔️

Ten Core Update bardzo wyraźnie rozrysował linie podziału. Nie było tu wielu szarości — w większości przypadków strony albo wyraźnie zyskiwały, albo mocno traciły. Poniżej najważniejsze wzory, które powtarzały się w danych i które widziałem też na własnych projektach.

-

Specjaliści vs. generalni

Bardzo czytelny sygnał: niszowe, głęboko wyspecjalizowane serwisy wygrywały, a szerokie portale traciły. Wzrosty rzędu +300–400% visibility nie były wyjątkiem, podczas gdy generaliści i „wszystko-mające” portale notowały solidne spadki. Google wyraźnie faworyzuje deep specialization zamiast szerokiego coverage. -

Verified reviews > open UGC

Platformy oparte o zweryfikowane recenzje rosły bardzo mocno, podczas gdy klasyczne UGC, fora i otwarte systemy opinii spadały. Weryfikacja użytkownika (transaction-verified, enrollment-verified itd.) stała się realnym buforem ochronnym przed spamem i manipulacją AI. -

Affiliate sites – ekstremalna polaryzacja

Aż 71% stron afiliacyjnych raportowało negatywne efekty. Kluczowa różnica:

agregacja i „research bez dotykania produktu” spadały nawet 80–90%, natomiast strony z realnymi testami, czasem spędzonym z produktem i osobistymi wnioskami często utrzymywały się lub zyskiwały. Experience w E-E-A-T stało się w afiliacji praktycznie obowiązkowe. -

E-commerce & retail – największy sektor wzrostowy

Średnie wzrosty rzędu +14–52%. Wygrywały marki z realnym doświadczeniem użytkownika, silnym brandem i jasnym transactional intent. Update bardzo mocno wzmocnił brand signals + intencję zakupową. -

YMYL poza zdrowiem i finansami

E-E-A-T (zwłaszcza Experience) zostało rozszerzone na recenzje, poradniki i buying guides. To już nie jest tylko „klasyczny YMYL” — dziś dotyczy szeroko pojętego contentu decyzyjnego. -

Post-rollout refinements

Część spadków — szczególnie w newsach, socialach i UGC — zaczęła odbijać po 29 grudnia. To sugeruje, że Google prowadził dodatkowe korekty po oficjalnym zakończeniu rollout’u. -

Discover i news – osobna rzeźnia

Wielu publisherów straciło 50–98% impressions w Discover. Clickbait, niejasne ownership i agregacja bez wartości zostały bardzo mocno przycięte. -

„Decision-making system” zamiast „SEO website”

Bardzo trafny komentarz z branży: strony wygrywające w 2026 to nie projekty robione pod SEO, tylko systemy wspierające decyzje użytkownika — z tożsamością, głębią i odpowiedzialnością (identity, depth, accountability).

Na dzień 7 lutego burza wciąż trwa, szczególnie w obszarze YMYL. Największe zmienności widać w:

-

branży News (wycinanie AI slopu, thin contentu, wielotematyczności, nieaktualnych treści),

-

branży finansowej (nieaktualność contentu i braki w E-E-A-T).

I dobra wiadomość na koniec: małe strony firmowe radzą sobie relatywnie dobrze, jeśli są wyspecjalizowane, aktualne i oparte na realnym doświadczeniu. To jeden z niewielu update’ów, który nie premiuje wyłącznie „największych”.

4.1 Cechy stron, które ZAZWYCZAJ ZYSKAŁY:

-

Silna specjalizacja / głęboka nisza (hyper-niche, deep expertise w wąskim temacie zamiast szerokiego coverage)

-

Autentyczne doświadczenie użytkownika / first-hand experience (realne testy produktów, osobiste wnioski, case studies, „ja tam byłem / testowałem”)

-

Zweryfikowane recenzje / platformy z barierami zaufania (verified reviews, transaction-verified, enrollment-verified → Trustpilot, Capterra, Healthgrades itp.)

-

Komercyjny / transactional content od uznanych marek (e-commerce, retail, apparel, direct-to-consumer brands)

-

Wysoka jakość + świetny UX (Core Web Vitals na wysokim poziomie, szybkie ładowanie, mobile-first, brak ciężkich reklam/affiliate barier)

-

Clear topical ownership + entity alignment (strona jasno „własna” w temacie, silne brand signals)

-

Long-form / expert-led content z autorami + credentials (imię, bio, kwalifikacje widoczne)

-

Wysoki % branded search / silna marka (powyżej ~4% branded clicks → większa odporność)

4.2 Cechy stron, które ZAZWYCZAJ PRZEGRAŁY:

-

Szerokie / generalistyczne portale (duże coverage bez głębokiej specjalizacji)

-

Thin / mass-produced / low-value content (duża ilość treści bez głębi, unikalności czy wartości)

-

Otwarte UGC / fora / social Q&A bez weryfikacji (Reddit, Quora, Wikipedia, Yelp, TripAdvisor – spadki mimo jakości)

-

Affiliate / review sites bez realnych testów (agregacja, thin research, brak osobistego doświadczenia)

-

News publishers / clickbait / aggregation (zwłaszcza w Discover – masowe spadki impressions)

-

Health / YMYL bez mocnego E-E-A-T (zwłaszcza brak Experience → Healthline, WebMD, MedicalNewsToday)

-

Słaby UX / behavioral signals (wolne ładowanie, wysokie bounce rate, słabe INP, ciężkie popupy/reklamy)

-

Content zoptymalizowany pod SEO/AI bez ludzkiej wartości (keyword stuffing, templated, masowa AI bez edycji)

5. Czy przewidywania ekspertów się sprawdziły? 🤔

Mam wrażenie, że eksperci liczyli na coś więcej. Po grudniowym Core Update miało być „czyściej”, a tymczasem użytkownicy dalej narzekają na AI slop w wynikach wyszukiwania. I szczerze — nie sądzę, żeby Google był w stanie (albo nawet chciał) całkowicie wyczyścić treści generowane przez AI.

Gdy rozglądam się po sieci i analizuję SERP-y, widzę wyraźnie, że AI slop może mieć się całkiem dobrze, jeśli autor strony zadba o odpowiednie zaangażowanie użytkownika. Liczba zdarzeń na stronie, interakcje, dwell time — to wszystko potrafi „przykryć” fakt, że treść została wygenerowana masowo. Problem z AI slopem jest taki, że… często czyta się go bardzo dobrze. Nierzadko płynniej niż artykuły pisane przez realnych ekspertów, którzy nie zawsze potrafią dobrze opowiedzieć o tym, co wiedzą.

Ogromną rolę odgrywa też autorytet domeny. W wynikach nadal trafiają się strony z treścią przeciętną, a momentami wręcz słabą, które trzymają pozycje tylko dlatego, że stoją za nimi gigantyczne, zaufane marki. To samo widzę, czytając blogi konkurencji — w większości przypadków są to teksty niskiej jakości, które nie wnoszą nic nowego do spojrzenia na temat, a mimo to rankują.

Podsumowując: na pozycję w rankingu wpływa dziś znacznie więcej czynników niż to, czy treść jest produktem AI, czy nie. Liczy się autorytet, UX, zaangażowanie użytkownika, kontekst strony jako całości. A dobra treść — niezależnie od tego, jak powstała — ma jedną wspólną cechę: uczy nas czegoś nowego. I myślę, że dokładnie tym powinniśmy się kierować, pisząc jakikolwiek nowy artykuł na blogu.

6. Jak tworzyć treści, by podczas Core Update zyskiwały? ✍️🧠

Zacznijmy od rzeczy najważniejszej: nie ma dziś większego znaczenia, czy tworzysz treści samodzielnie, czy przy pomocy AI. To naprawdę nie jest już o tym. Moja pierwsza i najważniejsza rada brzmi: porzuć narzędzia badające nasycenie słowami kluczowymi. To przestało działać. Druga rada: jeśli nie zaczniesz dzielić się swoją wiedzą i doświadczeniem, to po prostu nie znajdzie się dla Ciebie miejsce w Google.

I ostatnia trzecia rada: każdy z nas ma unikalne doświadczenie w swojej branży. I właśnie to powinno być fundamentem treści. Artykuły nie mają być „opisem tematu”, tylko wglądem w to, jak Ty ten temat rozumiesz, badałeś, testowałeś, przeżyłeś. Nawet jeśli wygenerujesz artykuł w 100% przez AI, ale zrobisz to na bazie własnych obserwacji i wniosków, taka treść już ma unikalną wartość.

Ja osobiście podchodzę do tego tak: zajmuję się analizą, szukaniem, badaniem. Mam wiedzę, ale polonistą nie jestem. To, co wiem, wrzucam do opracowania sztucznej inteligencji i powstaje coś unikalnego — jak ten artykuł, który właśnie czytasz.

W tworzonych treściach musisz udowodnić, że temat znasz i zgłębiałeś. W tym tekście posiłkuję się:

-

wnioskami ekspertów, których śledzę,

-

danymi,

-

wykresami,

-

print screenami, które zbieram od grudnia.

Przygotowywałem się do niego tygodniami. I to jest dokładnie ten sygnał, którego Google dziś szuka.

Bardzo mocno polecam case studies. I nie chodzi o marketingowe historyjki sukcesu, tylko o:

-

pokazanie procesu,

-

opisanie błędów,

-

wniosków,

-

tego, co zadziałało i co nie.

Case study to czyste Experience w E-E-A-T.

Zadbaj też o zdarzenia na stronie. AI pozwala uczynić treść przystępną, dzięki czemu użytkownik jest w stanie dojechać do końca artykułu. Interaktywne wykresy, tabele, elementy wizualne czy nawet prosty film (ja akurat filmu tu nie dałem — nie jestem YouTuberem 😉) wydłużają czas spędzony na stronie. A Twoim zadaniem jest wydłużyć go jak najbardziej.

I powiem coś, co bardzo mi się w tym wszystkim podoba: SEO doszło do momentu, w którym kombinujemy, jak przypodobać się czytelnikowi, a nie maszynie Google.

Słowa kluczowe? W ogóle na to nie patrz. Tekst sam nasyci się tym, co potrzebne. Kiedyś używałem neurowritera i efekty były mierne. Dziś skupiam się na tym, co jeszcze mogę czytelnikowi realnie pomóc zrozumieć.

I to — moim zdaniem — jest jedyna sensowna droga na Core Update 2025 i dalej.

Warto przeczytać:

- Jak przygotować opisy produktów do sklepu internetowego?

- Jak samodzielnie pozycjonować sklep internetowy w Google?

7. Co zrobić po Core Update? Rekomendacje praktyczne? 🛠️

Co powinieneś zrobić, jeśli jesteś w grupie przegranych? Przede wszystkim — spokojnie. Dla mnie każdy Core Update to ciekawy eksperyment. W Design Cart przy każdym update’cie wypuszczamy kilka stron przygotowanych specjalnie po to, żeby wyjść z niełaski Google. I mogę Cię uspokoić: praktycznie wszystko da się odkręcić, ale musisz przygotować się na wielomiesięczną, systematyczną pracę.

Tu nie chodzi o szybkie poprawki ani jednorazowe akcje SEO. Chodzi o trwałość zmian. Z moich obserwacji wynika, że po około 6 miesiącach regularnej pracy zaczynają pojawiać się pierwsze sygnały odbicia — na początku bardzo nieśmiało.

Bardzo ważna rzecz: po Core Update warto odczekać około 4 tygodnie i po prostu obserwować. W trakcie rollout’u strony często spadają dramatycznie, czasem „w otchłań”, tylko po to, żeby chwilę później wrócić. Reagowanie w panice to najgorsze, co możesz zrobić.

Przejdźmy do kroków prowadzących do chwały 👇

Sprawy techniczne strony ⚙️

-

Sprawdź Core Web Vitals (np. w PageSpeed Insights) i dostosuj stronę do wymagań Google.

-

Ogranicz reklamy i afiliacje, szczególnie te, które przeszkadzają w konsumowaniu treści.

Aktualizacja treści na stronie ✍️

-

Usuń fluff content, głównie to, czego nie da się realnie poprawić: treści pisane pod SEO, przestarzałe, nic niewnoszące.

Staraj się, aby usunięta treść nie przekraczała 30% całości. -

Zaktualizuj nieaktualne treści i zadbaj, aby data aktualizacji była widoczna.

-

Sprawdź, czy Twoje treści są zgodne z E-E-A-T i HCU. Nawet ChatGPT może tu pomóc — wystarczy wkleić tekst i poprosić:

„Oceń treść pod względem E-E-A-T i HCU i napisz, co mogę poprawić”. -

Zadbaj o dwell time: uatrakcyjniaj treści dowodami ekspertyzy — tabele, wykresy, interakcje, filmy, print screeny.

-

Sprawdź intencję treści. Podczas grudniowego Core Update poleciało wiele stron, które na frazy komercyjne rankowały długimi artykułami edukacyjnymi — solidnymi, ale niedopasowanymi do intencji.

-

Dodawaj wartościowe nowe treści regularnie. Tempo publikacji powinno być zbliżone do konkurencji, ale jakość zawsze wygrywa z ilością.

Jakość ogólna strony 🧩

-

Dostosuj stronę jako całość do wytycznych E-E-A-T:

strona o firmie, bio autorów, polityka prywatności, regulaminy, historia firmy, pełne dane kontaktowe, formularze. -

Popraw linkowanie wewnętrzne.

Wyznacz główne huby tematyczne, linkuj do treści uzupełniających i z nich wracaj do hubów. Usuń uszkodzone linki 404. -

Oceń UX strony. Czy użytkownik po wejściu od razu dostaje to, czego oczekuje?

Kiedyś klient zapytał mnie, czy Google potrafi ocenić, czy strona jest przyjazna w obsłudze. Odpowiadam od razu: nie. Google sprawdzi to inaczej — przez czas spędzony na stronie i liczbę ucieczek. Spryciarz.

Sygnały z zewnątrz 🌍

-

Zadbaj o sygnały zewnętrzne, i nie muszą to być wyłącznie linki.

Liczą się wzmianki o marce, opinie w sieci, obecność w ważnych serwisach branżowych. -

Warto jednak zaznaczyć jedno: z moich analiz wynika, że największe spadki po Core Update wynikają głównie z problemów wewnątrz strony, a nie z braku linków.

Kiedy zobaczysz efekty zmian na stronie? ⏳

Zbierając informacje z branży i uśredniając doświadczenia specjalistów, da się nakreślić pewną drogę czasową, którą najczęściej przechodzą strony wychodzące z problemów po Core Update:

-

1–4 tygodnie → prawie nic nie widać (wdrażasz zmiany)

-

5–8 tygodni → pierwsze sygnały, zwykle 5–15% odbicia (na najlepiej poprawionych podstronach)

-

3–4 miesiące → 20–40% powrotu

-

5–6 miesięcy → 50–80% (to najczęściej spotykany zakres)

-

6–12 miesięcy → pełny powrót lub nawet wyżej, jeśli realnie poprawiłeś stronę

W wychodzeniu z niełaski Google kluczowy jest czas i systematyka. Nie chciałbym, żebyś się zniechęcał nie widząc zmian, dlatego ja osobiście odrzuciłbym pierwsze 1–2 miesiące z kalkulacji. Wszystkie strony, które wyprowadzałem po dotknięciu palcem śmierci HCU, zaczynały pokazywać realne pozytywne zmiany dopiero po 4–5 miesiącach.

Specjaliści często liczą ten czas od momentu rozpoczęcia zmian, ale to nie jest parametr obiektywny. Każdy ma inne tempo wdrażania. Jeśli miałbym stosować widełki czasowe, liczyłbym je od momentu, gdy strona przeszła totalny glow up. Jeżeli wdrażałeś Core Web Vitals i E-E-A-T przez 3 miesiące — zaczynamy liczyć od pierwszego dnia po zakończeniu tych prac, a nie od ich startu.

Jak wspomniałem wcześniej — czas ma ogromne znaczenie. Zauważyłem też, że strony dotknięte algorytmami HCU w 2023 roku potrzebowały dwóch, a czasem trzech Core Update’ów, żeby wrócić na prostą. Nie zdarzyło mi się, żeby wystarczył jeden. Dlaczego tak jest? Myślę, że Google ma coś na kształt mechanizmu piaskownicy, który obserwuje:

-

czy zmiany są systematyczne,

-

czy poprawa jakości jest trwała,

-

czy to realny glow up, a nie jednorazowa akcja SEO.

W ten sposób Google próbuje odfiltrować jednostrzałowych manipulatorów.

Przypominam też ważną rzecz: jeśli usuwałeś fluff content, podczas pierwszego Core Update możesz drastycznie spaść. Wtedy pojawia się wyrwa w Twoim SQS, a nowa jakość — budowana nową treścią — nie jest jeszcze w pełni przeliczona. To jest spadek czasowy, choć psychicznie bardzo trudny.

Jakie więc realne ramy czasowe można przyjąć? Załóżmy, że:

-

poprawiłeś wszystkie aspekty techniczne,

-

uporządkowałeś treści,

-

regularnie dodajesz nowe materiały, nie rzadziej niż konkurencja,

-

dbasz o jakość i unikalność.

W takim scenariuszu pierwsze wyraźne zmiany powinny być widoczne po kolejnym Core Update, a bardziej skokowe odbicie lub pełny powrót — po jeszcze następnym. Przy średnio 3 Core Update’ach rocznie, realny czas wyjścia z problemów waha się od 6 do 12 miesięcy.

John Mueller z Google mówił, że odzyskanie ruchu po zmianach na stronie jest możliwe również pomiędzy Core Update’ami. Warto jednak pamiętać, że na Google Search Central Live w Zurychu (9 grudnia 2025) stwierdził, iż aktualizacja jest „w przygotowaniu”, ale nie spodziewa się jej w najbliższych tygodniach. Core Update ruszył… dwa dni później. Także...może trzymajmy się dat core updat'ów 😅.

Dlatego cierpliwość, konsekwencja i brak panicznych ruchów są dziś równie ważne jak same zmiany.

Podsumowanie 🧠⚡

Grudniowy Core Update 2025 nie był kolejną „rutynową” aktualizacją, którą można przeczekać. To był jeden z najbardziej przełomowych momentów w SEO ostatnich lat, bo bardzo wyraźnie pokazał, w jakim kierunku Google faktycznie zmierza. Nie w stronę lepszego wykrywania słów kluczowych. Nie w stronę coraz sprytniejszych trików optymalizacyjnych. Tylko w stronę oceny sensu istnienia strony jako całości.

Ten update obnażył kilka niewygodnych prawd. Po pierwsze: sama treść to za mało. Możesz mieć poprawny, merytoryczny content, a mimo to przegrać, jeśli UX jest słaby, strona wolna, przeładowana reklamami albo nie daje użytkownikowi komfortu konsumowania informacji. Po drugie: AI nie jest problemem samym w sobie. Problemem jest brak odpowiedzialności, doświadczenia i realnej wartości dodanej. AI slop nadal potrafi rankować — szczególnie tam, gdzie autorzy dbają o zaangażowanie użytkownika i mają silny autorytet domeny.

Najważniejszy wniosek jest jednak taki, że E-E-A-T przestało być teorią, a stało się praktycznym filtrem jakości. Experience i Expertise nie są już miłym dodatkiem, tylko fundamentem — zwłaszcza w contentcie decyzyjnym, komercyjnym i afiliacyjnym. Google coraz wyraźniej faworyzuje specjalistów, głęboką niszę, autentyczne doświadczenie i strony, które realnie pomagają użytkownikowi podjąć decyzję.

Dla wielu wydawców — szczególnie w newsach, UGC i YMYL — był to bolesny update. Ale jednocześnie jest to dobra wiadomość dla mniejszych, wyspecjalizowanych stron, które do tej pory ginęły w cieniu dużych portali. Ten Core Update pokazał, że da się wygrać z „wielkimi”, jeśli masz wiedzę, doświadczenie i potrafisz je sensownie przekazać.

Na koniec najważniejsze: wychodzenie z niełaski Google to proces, nie sprint. Wymaga czasu, systematyki i konsekwencji. Czasem jednego Core Update’u, czasem dwóch lub trzech. Ale jeśli poprawiasz stronę realnie — technicznie, treściowo i jakościowo — efekty prędzej czy później przychodzą.

SEO w 2026 roku nie będzie polegało na optymalizowaniu pod algorytm. Będzie polegało na projektowaniu stron, które mają sens dla ludzi. I grudniowy Core Update 2025 był bardzo wyraźnym sygnałem, że dokładnie w tym kierunku Google już jest.

Słownik pojęć użytych w artykule

-

Core Update – Duża, globalna aktualizacja algorytmu Google, która zmienia sposób oceniania stron jako całości. Po Core Update strony mogą mocno zyskać lub stracić, nawet jeśli „nic nie zepsuły”.

-

E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) – Zestaw kryteriów jakości treści i stron: doświadczenie autora, jego wiedza, autorytet oraz wiarygodność. W 2025 roku kluczowe stały się Experience i Expertise.

-

YMYL (Your Money or Your Life) – Treści dotyczące zdrowia, finansów, prawa i bezpieczeństwa, czyli tematów wpływających na życie lub pieniądze użytkownika. Google ocenia je znacznie ostrzej niż inne.

-

HCU (Helpful Content Update) – Aktualizacja algorytmu promująca treści pomocne dla użytkownika, a nie pisane wyłącznie pod SEO. Uderza w masową produkcję niskiej jakości contentu.

-

AI slop – Potoczne określenie na masowo generowane treści AI bez nadzoru człowieka, pozbawione doświadczenia, odpowiedzialności i realnej wartości.

-

Navboost – System Google analizujący zachowanie użytkowników po kliknięciu w wynik wyszukiwania, m.in. UX, reklamy, popupy, afiliacje i komfort korzystania ze strony.

-

UX (User Experience) – Doświadczenie użytkownika na stronie: szybkość ładowania, czytelność, brak przeszkadzających reklam i łatwość poruszania się.

-

Core Web Vitals (CWV) – Zestaw wskaźników technicznych mierzących komfort użytkowania strony, m.in. szybkość ładowania, responsywność i stabilność layoutu.

-

Dwell time – Czas, jaki użytkownik spędza na stronie po wejściu z Google. Im dłużej czyta, scrolluje i wchodzi w interakcje, tym lepiej dla strony.

-

Behavioral signals (sygnały behawioralne) – Zachowania użytkowników na stronie, takie jak czas spędzony, liczba interakcji, szybkie wyjścia czy powroty do wyników wyszukiwania.

-

SQS (Site Quality Score) – Nieoficjalne określenie ogólnej oceny jakości strony przez Google, obejmujące treści, UX, zaufanie i historię domeny.

-

Fluff content – Treści nic niewnoszące, rozwleczone, często przestarzałe, tworzone głównie pod SEO, a nie dla użytkownika.

-

Thin content – Zbyt krótkie i powierzchowne treści, które nie odpowiadają na intencję użytkownika i nie wyczerpują tematu.

-

UGC (User Generated Content) – Treści tworzone przez użytkowników, takie jak komentarze, fora, pytania i odpowiedzi czy otwarte recenzje.

-

Verified reviews – Recenzje powiązane z realnym użytkownikiem lub transakcją, np. po zakupie lub rezerwacji, trudniejsze do zmanipulowania.

-

Affiliate site – Strona zarabiająca na polecaniu produktów lub usług, która w 2025 roku wygrywa tylko wtedy, gdy oferuje realne testy i doświadczenie.

-

Discover – Sekcja Google z polecanymi treściami (głównie mobilnie), bardzo wrażliwa na clickbait, brak wiarygodności i niejasne źródła.

-

SERP (Search Engine Results Page) – Strona wyników wyszukiwania Google; „burza w SERP-ach” oznacza dużą i nienaturalną zmienność pozycji.

FAQ – najczęstsze pytania po Core Update grudzień 2025

Czy Core Update grudzień 2025 był wyjątkowo mocny?

Tak. Nie dlatego, że „karał”, tylko dlatego, że przeliczał strony bardzo głęboko. Nietypowa cisza w trakcie rollout’u i ogromna zmienność po jego zakończeniu sugerują poważną recalibrację jakości stron, a nie zwykłe korekty.

Czy Google karze treści pisane przez AI?

Nie. Google nie karze za AI jako technologię. Karze za brak jakości, brak doświadczenia i brak odpowiedzialności autora. Treści AI z ludzkim nadzorem, doświadczeniem i realną wartością nadal potrafią rankować bardzo dobrze.

Dlaczego dalej widzę AI slop w wynikach wyszukiwania?

Bo AI slop dobrze się czyta, generuje interakcje i często stoi na domenach o dużym autorytecie. Google nie jest w stanie (i raczej nie chce) całkowicie go usunąć — filtruje go pośrednio przez UX, zaangażowanie i E-E-A-T.

Czy usuwanie fluff contentu to dobry pomysł?

Tak, ale krótkoterminowo może boleć. Usuwanie dużej ilości treści może spowodować chwilowy spadek (wyrwa w SQS), który często odrabia się dopiero po kolejnym Core Update. To normalne.

Czy po spadkach trzeba od razu coś robić?

Nie. Po Core Update najlepiej odczekać około 4 tygodnie i obserwować. W trakcie rollout’u strony często spadają tylko po to, żeby później wrócić. Panika i szybkie zmiany zwykle pogarszają sytuację.

Jak długo trwa wychodzenie z niełaski Google?

Najczęściej 6–12 miesięcy, przy założeniu systematycznej pracy. Pierwsze realne efekty często pojawiają się po 4–5 miesiącach, a pełny powrót wymaga zwykle więcej niż jednego Core Update’u.

Czy można odzyskać ruch między Core Update’ami?

Tak, jest to możliwe. Nawet John Mueller to potwierdza. Trzeba jednak uczciwie powiedzieć, że największe skoki widoczności najczęściej dzieją się właśnie przy kolejnych Core Update’ach.

Dlaczego duże portale też spadały?

Bo autorytet nie chroni już przed słabym UX, nieaktualnym contentem i brakiem Experience. Ten update bardzo mocno uderzył w generalistów, newsy i agregatory bez realnej wartości.

Czy małe strony mają dziś szansę wygrać?

Tak — i to jest jedna z najlepszych informacji po tym update’cie. Małe, wyspecjalizowane strony firmowe, z aktualnymi treściami i realnym doświadczeniem, radzą sobie relatywnie dobrze.

Czy linki nadal mają znaczenie?

Tak, ale nie są głównym problemem przy spadkach po Core Update. Z moich analiz wynika, że największe straty wynikają z problemów wewnątrz strony: treści, UX, E-E-A-T, intencji.

Czy wystarczy poprawić jeden element (np. treści)?

Nie. Core Update ocenia stronę holistycznie. Sama poprawa treści bez UX, techniki i zaufania zwykle nie wystarcza.

Czy warto dalej robić SEO?

Tak — ale to już nie jest SEO sprzed 5 lat. Dziś SEO to projektowanie stron, które mają sens dla ludzi, a nie kombinowanie pod algorytm. Grudniowy Core Update bardzo wyraźnie to potwierdził.

Sklepy internetowe Woocommerce

Sklepy internetowe Woocommerce Sklepy internetowe Opencart

Sklepy internetowe Opencart Sklepy internetowe Prestashop

Sklepy internetowe Prestashop Sklepy internetowe Magento

Sklepy internetowe Magento Strony internetowe Joomla!

Strony internetowe Joomla! Strony Internetowe Wordpress

Strony Internetowe Wordpress